W świecie technologii, gdzie postęp jest często świętym Graalem, zdarza się, że sami twórcy wstrzymują się przed udostępnieniem swoich najnowszych osiągnięć. Motywacją nie są zazwyczaj względy biznesowe, lecz głęboka etyczna refleksja i obawa przed konsekwencjami, jakie ich dzieło może przynieść społeczeństwu. Historia zna przypadki, w których naukowcy i inżynierowie, stojąc u progu przełomu, decydowali się na samokontrolę, uznając, że pewne technologie są po prostu zbyt potężne, by oddać je w ręce ludzi.

Granica odpowiedzialności

Decyzja o wstrzymaniu się z publikacją lub komercjalizacją zaawansowanej technologii jest zawsze niezwykle trudna. Wymaga ona od zespołów badawczych przejścia od roli entuzjastów postępu do roli strażników bezpieczeństwa. Kluczowe pytanie brzmi: gdzie leży granica między odpowiedzialnym rozwojem a lekkomyślnym udostępnianiem narzędzi, których skutków nie jesteśmy w stanie w pełni przewidzieć?

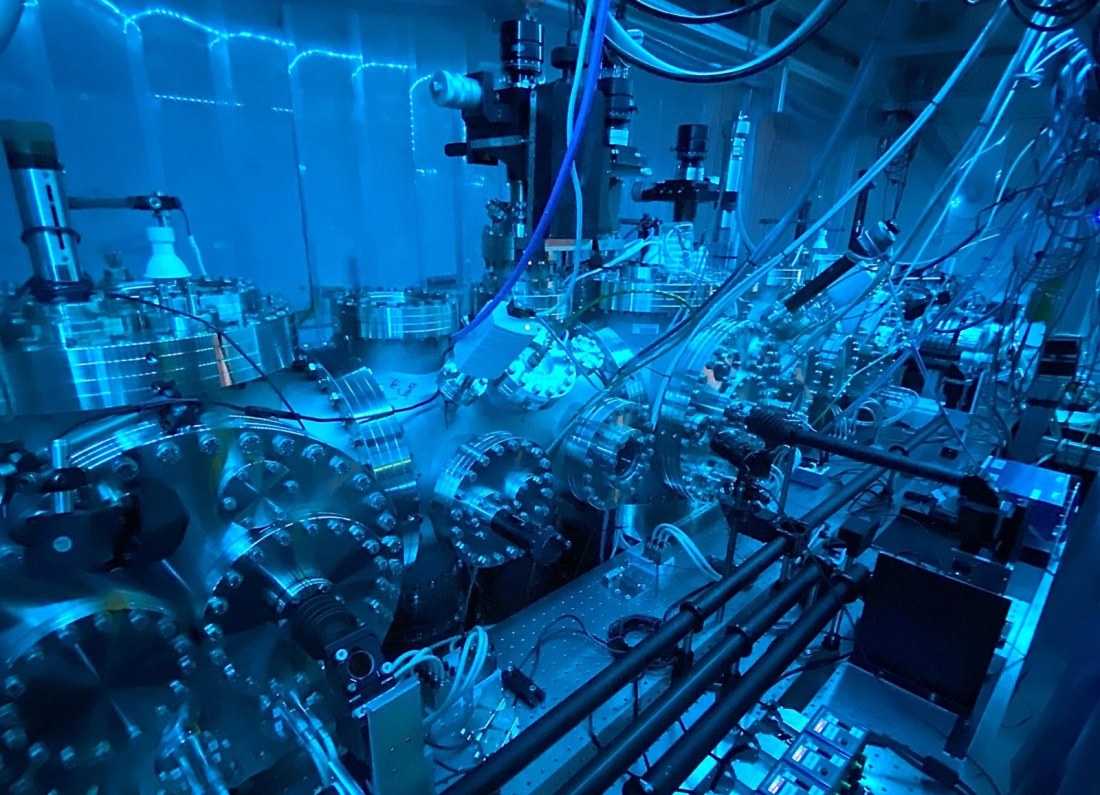

Takie dylematy nie są domeną wyłącznie science fiction. W rzeczywistości pojawiały się w kontekście badań nad sztuczną inteligencją, zaawansowanymi systemami broni autonomicznej czy technikami edycji genów, takich jak CRISPR. W każdym z tych przypadków część środowiska naukowego apelowała o ostrożność, moratoria lub ścisłe regulacje.

Przykłady z przeszłości i teraźniejszości

W 2019 roku OpenAI, organizacja badawcza zajmująca się sztuczną inteligencją, początkowo wstrzymała się od pełnego udostępnienia swojego potężnego modelu językowego GPT-2. Argumentowano, że technologia ta może być nadużyta do generowania dezinformacji na niespotykaną dotąd skalę. Był to wyraźny sygnał, że twórcy zdają sobie sprawę z dwuznaczności swojego wynalazku.

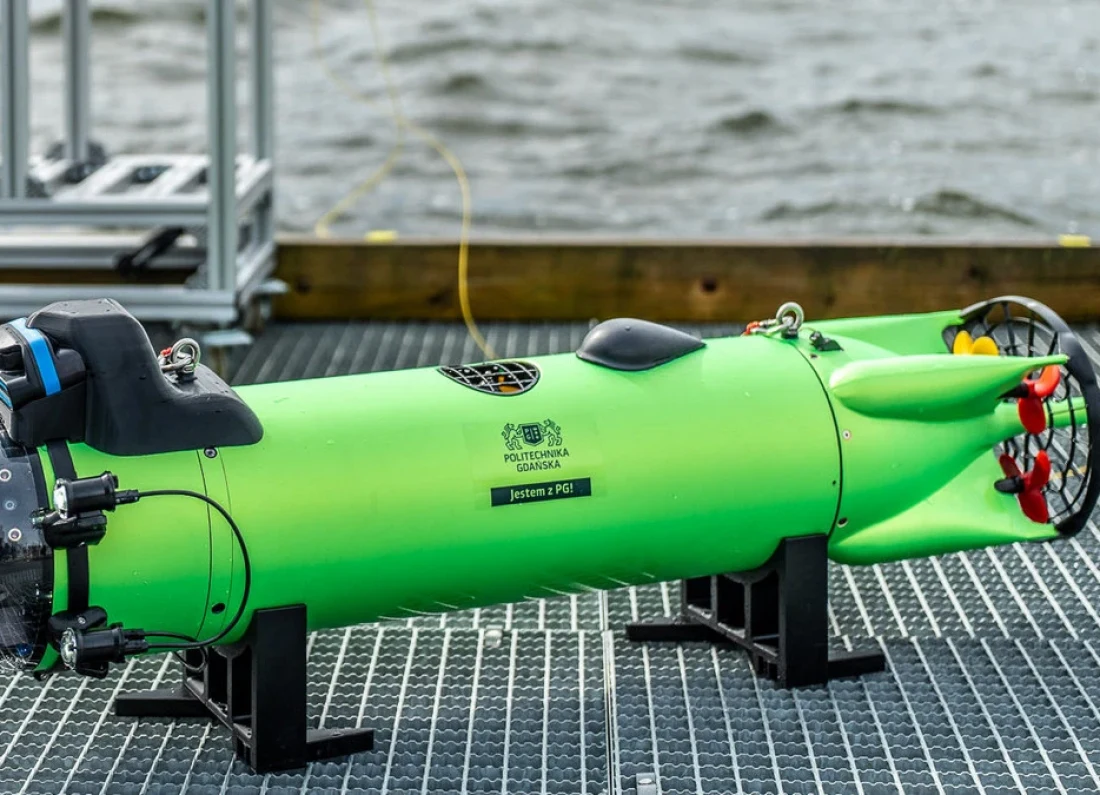

Podobne obawy towarzyszyły rozwojowi broni autonomicznej zdolnej do podejmowania decyzji o użyciu siły bez bezpośredniego nadzoru człowieka. Wielu ekspertów z dziedziny etyki i bezpieczeństwa międzynarodowego uważa, że tego typu systemy stwarzają nieakceptowalne ryzyko i powinny być zakazane traktatami międzynarodowymi.

„Największym wyzwaniem nie jest stworzenie potężnej technologii, lecz zapewnienie, że będzie ona służyła ludzkości, a nie jej zagrażała” – to credo, które przyświeca coraz większej liczbie zespołów badawczych.

Rola etyki i regulacji

Rosnąca świadomość ryzyka prowadzi do powstawania nowych dziedzin, takich jak etyka AI czy odpowiedzialna innowacja. Firmy technologiczne zaczynają powoływać rady etyczne, a rządy pracują nad ramami prawnymi. Kluczowe jest wypracowanie mechanizmów, które pozwolą czerpać korzyści z postępu technologicznego, jednocześnie minimalizując potencjalne szkody. Nie chodzi o hamowanie innowacji, lecz o ich inteligentne ukierunkowanie.

Ostatecznie, przypadki, w których twórcy „boją się” własnego dzieła, powinny być odbierane nie jako porażka, lecz jako oznaka dojrzałości. Świadczą one o tym, że społeczność naukowo-techniczna zaczyna brać pełną odpowiedzialność za długofalowe skutki swojej pracy. W erze, gdy technologia może zmieniać fundamenty społeczeństwa, taka ostrożność jest niezbędna. Przyszłość należy budować nie tylko na geniuszu inżynierów, ale także na mądrości i przewidywaniu konsekwencji.

Foto: cdn-sw.spidersweb.pl

Leave a Reply