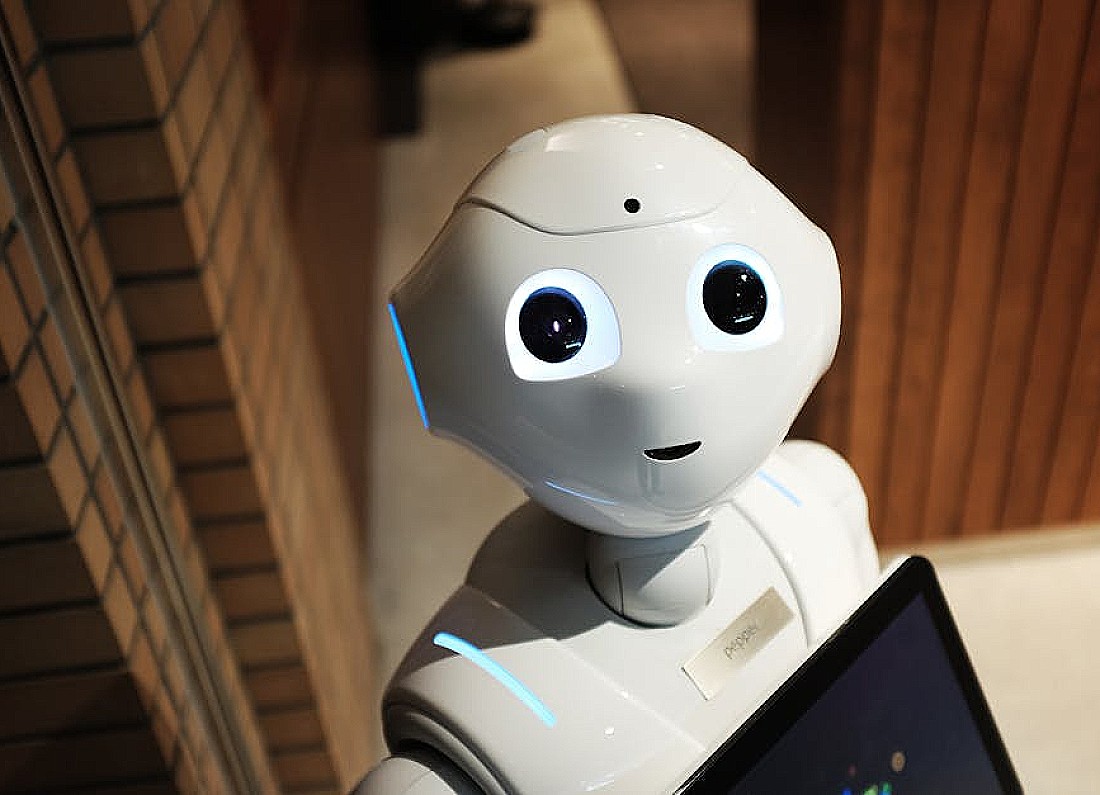

Spór prawny w Figure AI ujawnia luki w bezpieczeństwie robotów humanoidalnych

Kalifornijska firma Figure AI, specjalizująca się w tworzeniu zaawansowanych robotów humanoidalnych, znalazła się w centrum poważnego sporu prawnego. Robert Gruendel, były szef bezpieczeństwa produktów w firmie, złożył pozew przeciwko swojemu dawnemu pracodawcy, oskarżając go o zwolnienie w odwecie za ujawnienie niepokojących problemów związanych z bezpieczeństwem maszyn.

Zarzuty byłego szefa bezpieczeństwa

Według dokumentów sądowych, Gruendel twierdzi, że został zwolniony po tym, jak wielokrotnie zgłaszał obawy dotyczące fundamentalnych luk w systemach bezpieczeństwa robotów opracowywanych przez Figure AI. Jego zdaniem, firma priorytetowo traktowała tempo rozwoju produktu nad zapewnieniem odpowiednich zabezpieczeń, co mogło stanowić poważne zagrożenie dla użytkowników.

„Bezpieczeństwo powinno być integralną częścią procesu rozwoju, a nie dodatkiem wprowadzanym na ostatnim etapie” – stwierdził Gruendel w swoich zeznaniach.

Konsekwencje dla branży robotyki

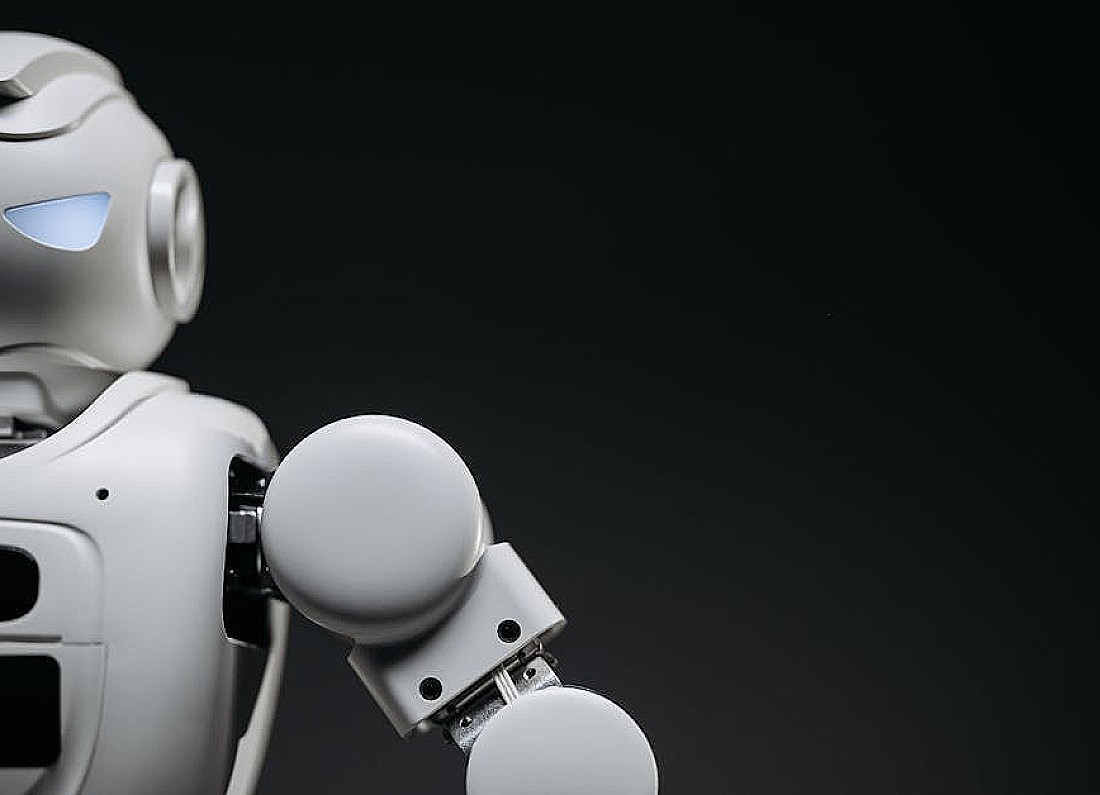

Sprawa Figure AI ma szersze implikacje dla całej branży robotyki humanoidalnej, która przeżywa obecnie dynamiczny rozwój. Eksperci zwracają uwagę, że podobne wyzwania mogą dotyczyć innych firm pracujących nad zaawansowanymi systemami autonomicznymi.

Kluczowe obszary ryzyka zidentyfikowane w pozwie:

- Niewystarczające testy awaryjnych systemów zatrzymania

- Brak odpowiednich protokołów na wypadek nieprzewidzianych zachowań robotów

- Niedostateczne zabezpieczenia przed cyberatakami

- Problemy z wykrywaniem i unikaniem przeszkód w czasie rzeczywistym

Odpowiedź Figure AI

Przedstawiciele Figure AI stanowczo zaprzeczyli zarzutom, twierdząc, że bezpieczeństwo zawsze było priorytetem w ich procesie rozwojowym. Firma wydała oświadczenie, w którym podkreśla swoje zaangażowanie w tworzenie „najbezpieczniejszych rozwiązań robotycznych na rynku”.

„Nasze standardy bezpieczeństwa przewyższają wymagania branżowe, a wszystkie nasze produkty przechodzą rygorystyczne testy przed wprowadzeniem na rynek” – czytamy w oficjalnym komunikacie firmy.

Perspektywy regulacyjne

Sprawa Figure AI zwraca uwagę na potrzebę opracowania bardziej szczegółowych regulacji dotyczących bezpieczeństwa robotów humanoidalnych. Obecnie branża funkcjonuje w dużej mierze w oparciu o ogólne wytyczne, które mogą nie uwzględniać specyficznych zagrożeń związanych z zaawansowanymi systemami autonomicznymi.

Eksperci prawa technologicznego sugerują, że incydent może przyspieszyć prace nad bardziej szczegółowymi standardami bezpieczeństwa dla robotów współpracujących z ludźmi w różnych środowiskach – od domów po zakłady przemysłowe.

Foto: www.unsplash.com

Leave a Reply