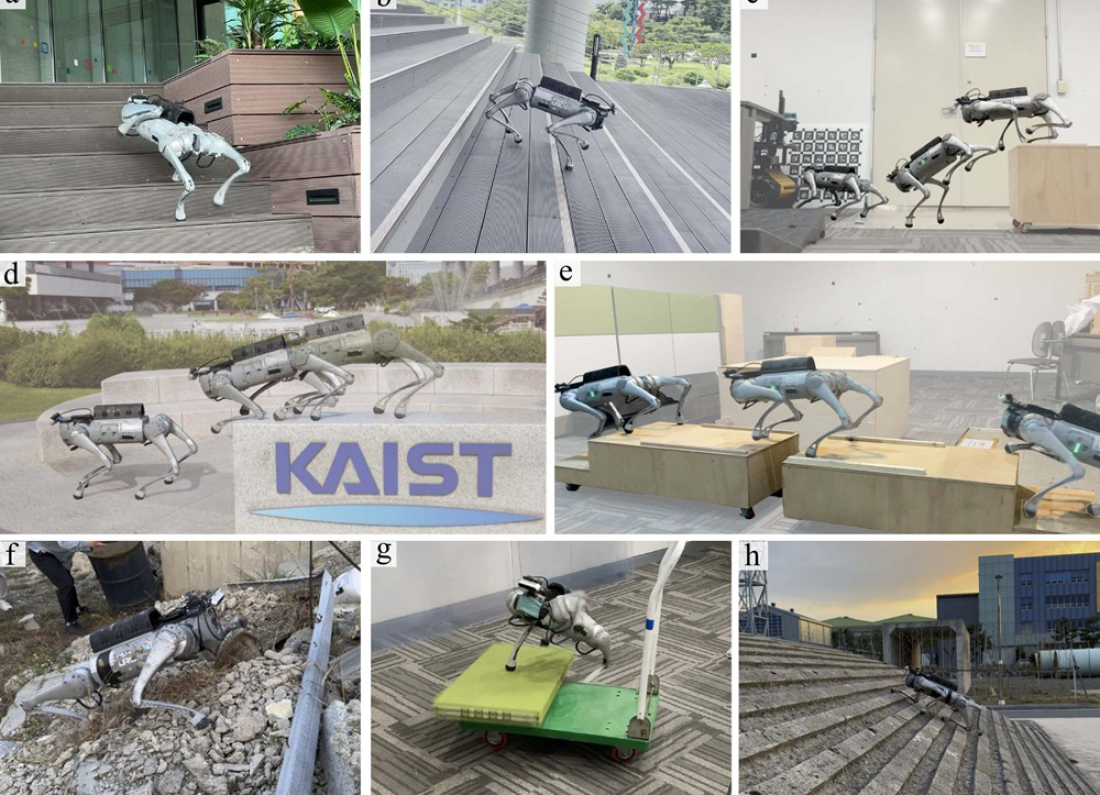

Roboty czworonożne, takie jak Boston Dynamics Spot czy Unitree Go1, zrobiły w ostatnich latach ogromne postępy w poruszaniu się po nierównym terenie. Ich zdolność do utrzymania równowagi i pokonywania przeszkód budzi podziw. Jednak, jak wskazują eksperci z Koreańskiego Zaawansowanego Instytutu Nauki i Technologii (KAIST), te maszyny wciąż cierpią na poważną wadę: swoistą “ślepotę”. Ich ruch opiera się głównie na reakcji na dotyk, co oznacza, że robot dowiaduje się o przeszkodzie dopiero wtedy, gdy w nią uderzy lub na nią nadepnie.

Reakcja zamiast przewidywania

Obecne systemy lokomocji robotów lepiej radzą sobie z terenem, który już znają lub który został wcześniej zeskanowany. W dynamicznym, nieprzewidywalnym środowisku ich możliwości są jednak ograniczone. Algorytmy sterujące często polegają na danych z czujników dotykowych w nogach, co jest strategią reaktywną, a nie proaktywną. To jak poruszanie się po ciemnym pokoju – dopiero po zderzeniu z meblem wiesz, że tam był.

Naukowcy z KAIST postanowili podejść do problemu z zupełnie innej strony. Ich inspiracją nie były inne roboty, ale natura, a konkretnie – drapieżniki.

Inspiracja ze świata zwierząt

Zespół badawczy przyjrzał się, w jaki sposób zwierzęta, takie jak gepardy czy wilki, poruszają się w trudnym terenie z dużą prędkością. Kluczem okazało się nie tyle wyczucie dotykowe, ile połączenie wzroku i propriocepcji (czucia własnego ciała w przestrzeni) w jeden, zunifikowany system percepcyjny. Drapieżnik nie czeka, aż jego łapa dotknie kamienia; widzi go z wyprzedzeniem i planuje ruch nogi tak, aby go ominąć lub wykorzystać jako punkt podparcia.

Nowy system opracowany w KAIST, nazwany roboczo “Raist”, ma na celu właśnie takie zintegrowanie danych wizualnych z danymi o położeniu i ruchu kończyn robota. Dzięki zaawansowanym algorytmom uczenia maszynowego, robot może teraz nie tylko “czuć” teren pod stopami, ale przede wszystkim go “widzieć” i przewidywać interakcje.

Jak działa nowa technologia?

System składa się z kilku kluczowych elementów:

- Zaawansowana kamera i czujniki głębi: Skanują teren przed robotem, tworząc w czasie rzeczywistym mapę wysokości i identyfikując potencjalne przeszkody.

- Procesor ścieżki ruchu: Algorytm na podstawie danych wizualnych planuje optymalną trajektorię dla każdej z nóg, unikając kolizji i wybierając najlepsze punkty podparcia.

- Szybka pętla sprzężenia zwrotnego: Dane z kamer są nieustannie porównywane z rzeczywistym położeniem nóg, co pozwala na korektę ruchu w ułamkach sekundy.

W praktyce oznacza to, że robot wyposażony w ten system może biec przez las, dynamicznie omijając korzenie i kamienie, które dostrzega na kilka kroków przed sobą. To jakościowa zmiana w stosunku do dotychczasowego, reaktywnego modelu poruszania się.

Potencjalne zastosowania i przyszłość

Możliwości zastosowania takiej technologii są ogromne. Przede wszystkim w misjach ratunkowych i inspekcyjnych, gdzie roboty muszą poruszać się w całkowicie nieznanym, często zawalonym gruzem środowisku. Zwiększona autonomia i płynność ruchu pozwoliłyby na szybsze i bezpieczniejsze dotarcie do poszkodowanych.

Ponadto, technologia może znaleźć zastosowanie w logistyce, na przykład w magazynach z wąskimi alejkami i licznymi przeszkodami, a także w rolnictwie precyzyjnym, gdzie maszyny autonomiczne muszą poruszać się po polu bez niszczenia upraw.

Prace zespołu z KAIST są na wczesnym etapie, ale pierwsze testy są niezwykle obiecujące. Jeśli uda się dopracować i skomercjalizować ten system, może on stać się nowym standardem w robotyce mobilnej, definiując sposób, w jaki maszyny postrzegają i nawigują w świecie fizycznym. To nie rewolucja, ale ewolucyjny krok, który może znacząco przyspieszyć rozwój całej dziedziny.

Foto: konto.chip.pl

Leave a Reply